تشغيل نموذج DeepSeek R1 Distilled على أجهزة كمبيوتر InHand AI Edge

DeepSeek R1، نموذج ذكاء اصطناعي مفتوح المصدر، يُعيد تعريف مفهوم الكفاءة والأداء في مجتمع الذكاء الاصطناعي. تُحوّل تقنيته المتطورة لتقطير المعرفة النماذج المعقدة إلى وحدات قوية خفيفة الوزن، مُوفرةً قدرات استدلالية فائقة. هذا المزيج من سهولة الوصول مفتوح المصدر والتصميم خفيف الوزن يُقلل من عوائق نشر الذكاء الاصطناعي، ويفتح آفاقًا جديدة للحوسبة الطرفية.

نجح فريق تكنولوجيا الذكاء الاصطناعي في InHand Networks للتو في نشر نموذج DeepSeek R1 المقطر على سلسلة EC5000 من أجهزة الكمبيوتر الطرفية ذات الذكاء الاصطناعييُثبت هذا الإنجاز الإمكانات الهائلة لأجهزة الحافة خفيفة الوزن في مهام استدلال الذكاء الاصطناعي. مقارنةً بعمليات النشر السحابية التقليدية، تُلغي حوسبة الذكاء الاصطناعي الحافة الحاجة إلى خوادم عالية الأداء، مما يُتيح الاستدلال الفوري في بيئات منخفضة الطاقة. وهذا يجعل حلول الذكاء الاصطناعي أكثر فعالية. مرنة وآمنة وفعالة لتطبيقات مثل فحص الجودة الصناعية، والنقل الذكي، والطب عن بعد.

تشغيل نموذج DeepSeek R1 Distilled على أجهزة الكمبيوتر EC5000 AI Edge

باتباع بضع خطوات فقط، يمكنك نشر نموذج DeepSeek R1 المقطر على أجهزة الكمبيوتر الطرفية من سلسلة EC5000:

الخطوة 1: تثبيت مجموعة أدوات Jetson Containers من Nvidia

(تساعد مجموعة الأدوات هذه على إدارة ونشر تطبيقات الذكاء الاصطناعي المحوسبة بكفاءة.)

قم بتشغيل الأوامر التالية لتنزيل مجموعة أدوات Jetson Containers وتثبيتها:

الخطوة 2: تثبيت Nvidia JetPack Toolkit

(يوفر JetPack برامج تشغيل ومكتبات أساسية لتشغيل أحمال عمل الذكاء الاصطناعي على الأجهزة التي تعمل بنظام Jetson.)

لتثبيت مجموعة أدوات JetPack، قم بتنفيذ:

انتظر لمدة دقيقة تقريبًا قبل الخطوات التالية.

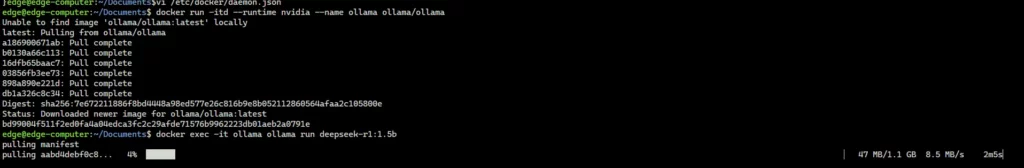

الخطوة 3: تنزيل وتشغيل Ollama Container

docker run -itd --runtime nvidia --name ollama ollama/ollama

الخطوة 4: تنزيل وتشغيل نموذج DeepSeek R1 Distilled باستخدام Ollama

مرجع: مكتبة DeepSeek R1

حدد نموذج DeepSeek R1 المقطر المناسب من مكتبة أولاما وتثبيته تلقائيًا عبر سطر الأوامر. على سبيل المثال، لتشغيل DeepSeek-R1-Distill-Qwen-1.5B نموذج، تنفيذ:

يمكنك استبدال deepseek-r1:1.5b بأي اسم طراز متاح آخر من صفحة بحث أولاما.

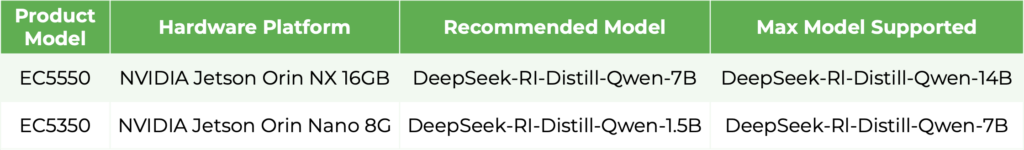

يوضح الجدول أدناه نماذج DeepSeek R1 المقطرة التي تدعمها أجهزة الكمبيوتر الطرفية EC5000.

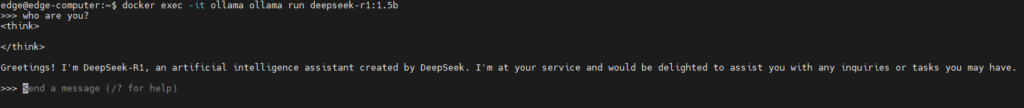

التفاعل مع النموذج

بمجرد تشغيل النموذج، يمكنك التفاعل معه مباشرة من خلال سطر الأوامر، مما يتيح لك إجراء استعلامات واستجابات في الوقت الفعلي مصممة خصيصًا لتطبيقات الذكاء الاصطناعي الخاصة بك.

ملحوظة: استبدل "deepseek-r1:1.5b" باسم النموذج الذي تريد استخدامه، استنادًا إلى متطلباتك المحددة.

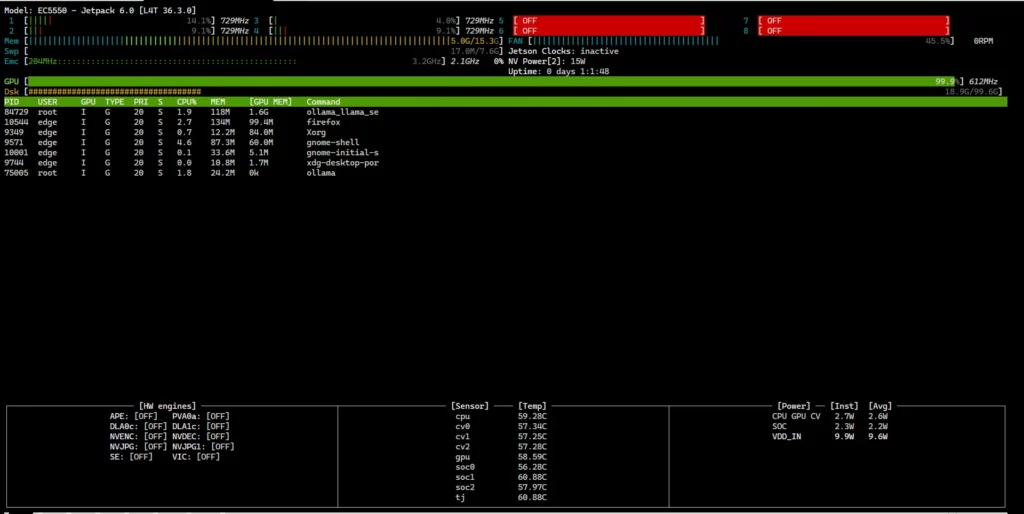

مراقبة استخدام أجهزة EC5000

للتحقق من استخدام وحدة المعالجة المركزية ووحدة معالجة الرسومات والذاكرة لجهاز الكمبيوتر EC5000 الخاص بك في الوقت الفعلي، استخدم جي توب يأمر:

سيؤدي هذا إلى عرض الحالة الحالية للجهاز.

مهم: يجب تنفيذ الأمر jtop باستخدام امتيازات الجذر.

ملاحظات إضافية

- In addition to the DeepSeek R1 distilled model, the EC5000 series edge computers also support other open-source large language models (LLMs), such as LLaMA 3.

- Running LLMs on EC5000 edge computers via Ollama is not the only method available—other deployment options can be explored based on your specific needs.

Deploying the DeepSeek R1 distilled model on the EC5000 series demonstrates the seamless integration of cutting-edge AI with edge computing hardware, paving the way for a new era of lightweight, high-performance edge AI.

As distillation technology continues to evolve, businesses can leverage these advancements to build private AI services, reducing computing costs while ensuring data security. This progress unlocks transformative opportunities across industries—from smart manufacturing and intelligent transportation to healthcare diagnostics and autonomous vehicles—enabling local data processing, reduced latency, enhanced data privacy, and real-time decision-making.

InHand Networks remains dedicated to advancing the edge intelligence ecosystem, empowering enterprises worldwide to embrace the future of intelligent edge computing.

المنتجات ذات الصلة: